Chaque semaine, plus de 230 millions de requêtes liées à la santé sont adressées à ChatGPT [1]. Ce chiffre colossal, révélé par OpenAI, illustre une tendance de fond : une demande massive et croissante des citoyens pour une information médicale plus accessible et personnalisée. Loin d’être un simple gadget technologique, l’intelligence artificielle (IA) s’installe durablement dans nos vies et, depuis le début de l’année 2026, elle frappe à la porte du cabinet médical avec une ambition renouvelée. Avec le lancement de « GPT Health » par OpenAI, suivi de près par les initiatives de ses concurrents comme Anthropic et Google, nous ne parlons plus de simples chatbots, mais d’assistants sophistiqués capables d’analyser nos données de santé personnelles pour nous aider à préparer une consultation ou à comprendre un bilan sanguin [2].

Cette évolution marque un tournant majeur pour la médecine et soulève une question fondamentale : cette révolution technologique est-elle la promesse d’une médecine plus efficace, prédictive et personnalisée, ou représente-t-elle une menace pour la confidentialité de nos données et la relation de soin si précieuse qui unit un patient à son médecin ? Cet article se propose d’explorer les multiples facettes de cette transformation, en analysant les différences de déploiement entre les États-Unis et la France, en sondant les attentes des patients et la position des médecins, et en décryptant les immenses défis réglementaires qui nous attendent.

Points clés à retenir :

L’intelligence artificielle en santé est un marché mondial en pleine explosion, qui pourrait dépasser les 1 000 milliards de dollars d’ici 2035 [2].

Un fossé se creuse entre les États-Unis, qui adoptent rapidement ces nouvelles technologies, et l’Europe, qui privilégie une approche réglementaire stricte pour protéger les données des patients [3].

Les médecins voient l’IA comme un outil puissant d’aide au diagnostic et à la gestion administrative, mais non comme un substitut à leur raisonnement clinique et à leur intuition [4].

La demande des patients pour une information médicale accessible est immense, mais la fiabilité des réponses de l’IA et la protection de la vie privée restent des préoccupations majeures [1].

GPT Health : qu’est-ce que c’est et comment ça marche ?

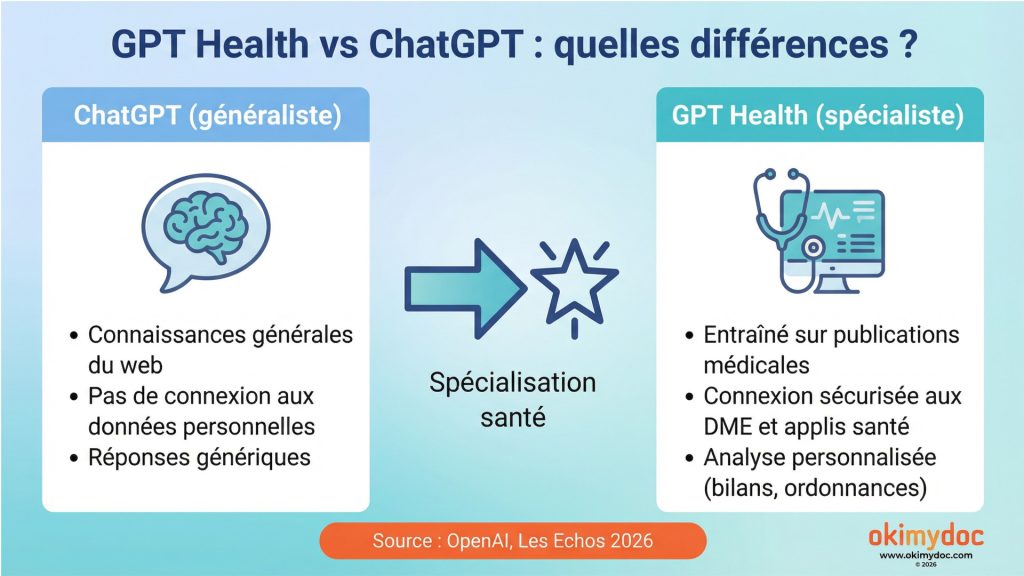

Avant d’analyser ses impacts, il est essentiel de comprendre ce qu’est réellement GPT Health et en quoi il diffère du ChatGPT que des millions de personnes utilisent déjà. Il ne s’agit pas simplement d’une mise à jour, mais d’une version spécialisée et verticalisée du modèle de langage, conçue spécifiquement pour le domaine médical.

La différence fondamentale ne réside pas tant dans le moteur d’IA lui-même que dans les données sur lesquelles il a été entraîné et les fonctionnalités qu’il propose. Alors que ChatGPT est un généraliste, GPT Health est un spécialiste.

-

Entraînement spécialisé : En plus des connaissances générales du web, GPT Health a été nourri avec une immense bibliothèque de contenus médicaux validés : publications scientifiques, manuels de médecine, bases de données de médicaments, recommandations de bonnes pratiques cliniques, etc.

-

Connectivité sécurisée (en théorie) : Il est conçu pour s’interfacer avec des sources de données personnelles via des API sécurisées, comme un dossier médical électronique (DME), les résultats d’un laboratoire d’analyse ou les données d’une application de suivi de santé.

-

Fonctionnalités dédiées : GPT Health propose des outils spécifiques qui n’existent pas dans la version standard. On peut citer par exemple :

-

L’analyse de documents : Vous pouvez lui soumettre une ordonnance, un compte-rendu d’imagerie ou une analyse de sang, et il peut en extraire les informations clés, les traduire en langage simple et les comparer aux valeurs de référence.

-

La préparation de consultation : L’outil peut aider un patient à synthétiser l’historique de ses symptômes, à lister ses questions pertinentes et à préparer un résumé clair pour son médecin.

-

Le suivi post-consultation : Il peut aider à décrypter une prescription, à comprendre la posologie d’un traitement et à mettre en place des rappels.

-

En résumé, si ChatGPT est un médecin généraliste autodidacte aux connaissances encyclopédiques mais parfois désordonnées, GPT Health se veut un assistant médical personnel, plus structuré et focalisé sur les données de l’utilisateur pour fournir une aide contextualisée.

Une nouvelle ère pour la santé : l’IA au chevet du patient

Le lancement de GPT Health début 2026 a officialisé une tendance que beaucoup pressentaient : l’IA ambitionne de devenir un véritable « compagnon de santé personnalisé » [3]. Cette offensive des géants de la tech n’est pas un hasard. Elle répond à une demande citoyenne profonde et à une réalité économique tangible.

-

Une demande massive des utilisateurs : Plus de 5% des centaines de millions de conversations sur ChatGPT concernent déjà la santé, et un quart de ses utilisateurs posent au moins une question médicale chaque semaine [2].

-

Un marché en pleine explosion : Le marché de l’IA appliquée à la santé, évalué à environ 50 milliards de dollars en 2025, devrait connaître une croissance exponentielle pour dépasser les 1 000 milliards de dollars à l’horizon 2035 [2].

Les raisons de cet engouement des patients sont multiples. Dans un contexte marqué par les déserts médicaux et un temps médical de plus en plus contraint, l’IA apparaît pour beaucoup comme une solution d’assistance accessible en permanence. Une étude européenne montrait d’ailleurs que 46% des adultes français trouvent difficile, voire très difficile, de trouver et d’utiliser de l’information de santé fiable en ligne [1]. L’IA conversationnelle, par sa simplicité d’usage, semble offrir une réponse directe à ce besoin de compréhension et d’autonomie dans la gestion de sa propre santé.

Le grand écart : la France et les États-Unis face à l’IA médicale

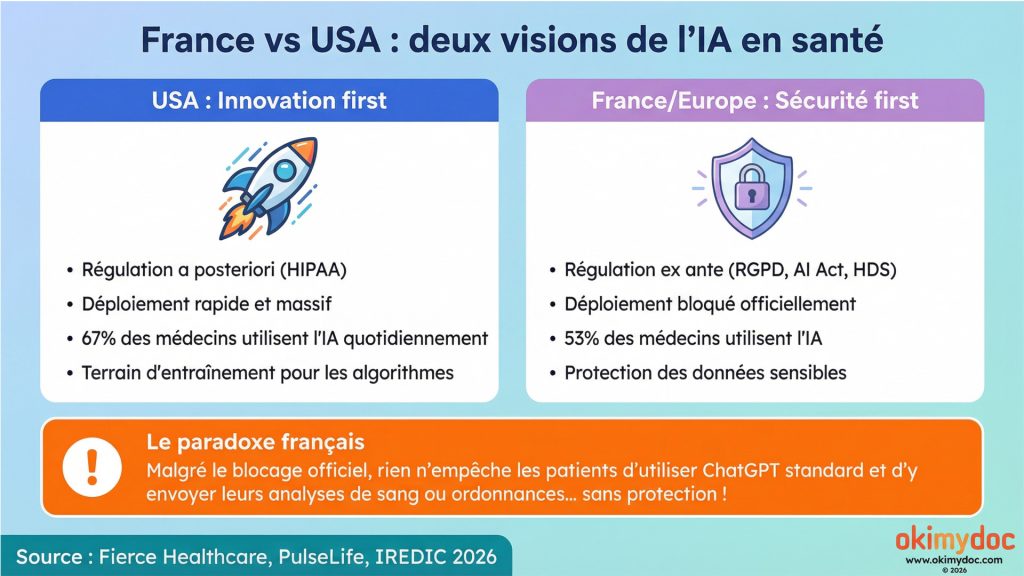

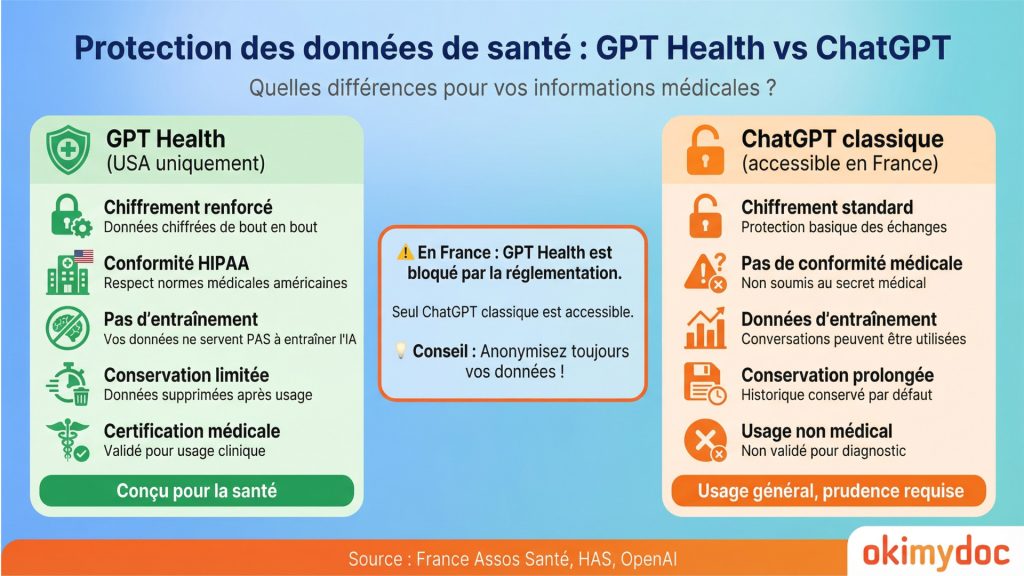

Face à cette vague technologique, deux visions du monde s’affrontent, créant un véritable grand écart entre les deux rives de l’Atlantique. D’un côté, les États-Unis ont adopté une approche favorisant l’innovation rapide ; de l’autre, l’Europe, et la France en particulier, a érigé la protection des données en principe cardinal, quitte à freiner le déploiement de ces nouveaux outils.

Le modèle américain : innover d’abord, réguler ensuite

L’approche américaine peut se résumer par la formule « innover d’abord, réguler ensuite ». Bien que la loi HIPAA encadre la confidentialité des données de santé, le déploiement de services comme GPT Health repose essentiellement sur le droit des contrats (via les conditions générales d’utilisation) et sur la responsabilité de l’opérateur en cas de problème. Cette logique de régulation a posteriori a permis une mise sur le marché très rapide, faisant des États-Unis un « terrain d’entraînement privilégié » pour ces algorithmes qui s’affinent grâce à l’analyse des données de millions de patients [3].

Le modèle européen : la forteresse réglementaire et le paradoxe de l’usage

À l’inverse, l’Union européenne oppose une logique de régulation ex ante, où la preuve de la conformité est un prérequis indispensable à toute mise sur le marché. Pour être autorisé en Europe, un outil comme GPT Health devrait franchir une triple muraille réglementaire :

-

Le RGPD : Le Règlement Général sur la Protection des Données qualifie les données de santé de « données sensibles » (Article 9) et en interdit le traitement par principe, sauf exceptions très strictes [3].

-

La souveraineté des données : L’impératif de souveraineté, consacré par l’arrêt Schrems II, rend illicite le transfert de données sensibles vers les États-Unis si un niveau de protection équivalent n’est pas garanti, ce qui est incompatible avec le Cloud Act américain [3].

-

L’AI Act : Le nouveau règlement sur l’IA pourrait classifier ces systèmes en « IA à haut risque », déclenchant des exigences de sécurité et de gouvernance extrêmement contraignantes avant toute commercialisation [3].

Cependant, cette forteresse réglementaire est confrontée à un paradoxe majeur : celui de l’usage réel. Alors que le déploiement officiel de GPT Health est bloqué en France, rien n’empêche aujourd’hui un citoyen français d’ouvrir son ordinateur, de se connecter à la version standard de ChatGPT et de lui soumettre ses données les plus personnelles. Des milliers de personnes le font déjà, en copiant-collant le compte-rendu de leur dernière analyse de sang ou en décrivant leurs symptômes pour obtenir un premier avis. Ce faisant, ils envoient volontairement leurs données de santé sur des serveurs américains, hors de toute protection du droit européen. La réglementation, pensée pour protéger, se trouve ainsi contournée par la pratique individuelle, créant une zone grise où les risques sont bien réels : absence de garantie sur la confidentialité, risque de réutilisation des données pour l’entraînement des modèles, et surtout, absence de validation médicale des réponses fournies.

| Critère | États-Unis | France / Europe |

|---|---|---|

| Approche | Innovation first, régulation a posteriori | Sécurité first, régulation ex ante |

| Cadre légal | Droit des contrats, HIPAA | RGPD, AI Act, Code de la santé publique (HDS) |

| Déploiement | Rapide et massif (déjà en cours) | Bloqué, mais contourné par l’usage individuel |

| Adoption (médecins) | Très élevée (67% d’usage quotidien en 2026) [6] | Significative mais plus faible (53% en 2024) [7] |

| Priorité | Vitesse d’innovation, part de marché | Protection des droits fondamentaux, sécurité |

Le médecin « augmenté » : l’IA, collègue ou concurrent ?

Si les patients s’emparent de l’IA, les médecins ne sont pas en reste. Loin de l’image d’une profession réfractaire au changement, les chiffres montrent une adoption déjà bien réelle. Aux États-Unis, 67% des médecins déclaraient utiliser des outils d’IA quotidiennement dans leur pratique début 2026 [6]. En France, ils étaient déjà plus d’un sur deux (53%) à intégrer l’IA dans leur quotidien en 2024 [7].

Les bénéfices attendus sont clairs :

-

Gain de temps administratif : Automatisation des comptes-rendus, gestion des dossiers.

-

Aide à la veille scientifique : Synthèse des dernières publications parmi des milliers de sources.

-

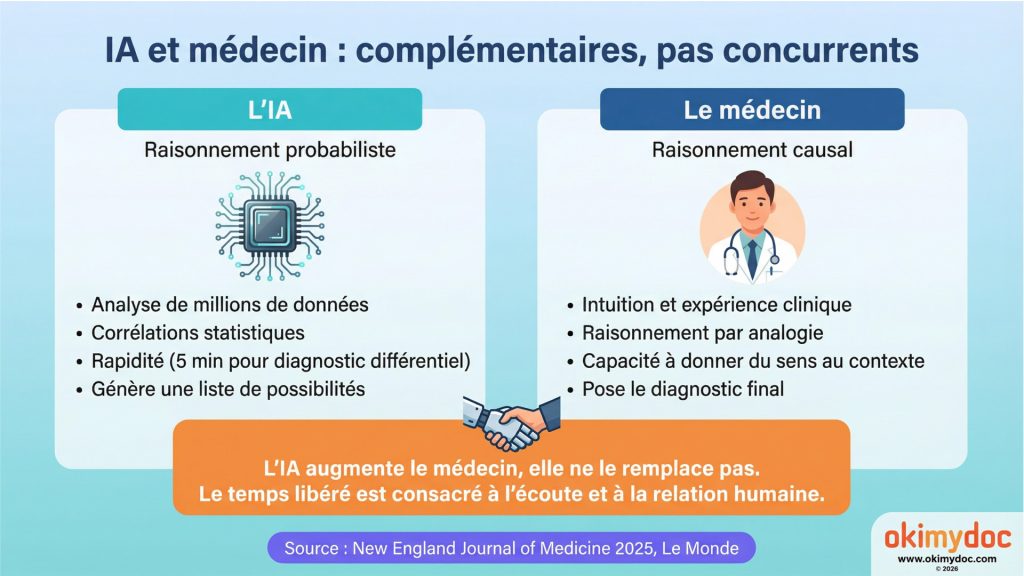

Support au diagnostic : Aide à l’établissement de diagnostics différentiels complexes [2, 4].

Cependant, considérer l’IA comme un futur remplaçant du médecin serait une erreur profonde, comme l’a brillamment illustré une étude publiée fin 2025 dans le prestigieux New England Journal of Medicine [4]. Des chercheurs y ont confronté un médecin expert en raisonnement clinique, le Dr Gurpreet Dhaliwal, et une IA baptisée « Dr CaBot », à un cas clinique particulièrement complexe. Si les deux sont parvenus à un diagnostic final quasi identique, seul le médecin a su faire preuve d’intuition pour identifier la cause première du problème, un cure-dents ingéré par le patient, un élément que l’IA, malgré l’analyse de millions de documents, n’a jamais envisagé.

En deux phrases : Le diagnostic différentiel est le processus par lequel un médecin évalue et hiérarchise plusieurs maladies possibles pour expliquer les symptômes d’un patient. L’IA peut générer une liste de possibilités en se basant sur des corrélations statistiques, mais le médecin reste essentiel pour interpréter le contexte, raisonner par causalité et poser le diagnostic final.

Cette étude met en lumière la différence fondamentale entre l’intelligence humaine et l’intelligence artificielle. La machine excelle dans le raisonnement probabiliste, en identifiant des corrélations dans une masse de données. Le médecin, lui, pratique un raisonnement causal, enrichi par son expérience, son intuition et sa capacité à créer des analogies pour donner du sens à l’histoire unique d’un patient. L’IA ne remplacera donc pas le praticien ; elle deviendra un collègue, un outil puissant qui l’assistera et « l’augmentera ». Le rôle du médecin évoluera vers celui d’un pilote expert de ces technologies, conservant le jugement critique et l’ultime responsabilité de la décision, pour consacrer le temps libéré à ce qui ne sera jamais automatisable : l’écoute, l’empathie et la relation humaine.

Conclusion

L’arrivée de l’intelligence artificielle dans le champ de la santé est bien plus qu’une simple innovation technologique ; c’est une vague de fond, portée par une demande immense des patients et un potentiel de transformation considérable, qui nous oblige à repenser les fondements de notre système de soin. Nous l’avons vu, un fossé réglementaire et philosophique sépare aujourd’hui l’approche américaine, axée sur la vitesse, de la prudence européenne, axée sur la sécurité. Ce décalage, s’il protège les citoyens européens, fait peser un risque de retard technologique pour la France et ses acteurs, tout en étant paradoxalement contourné par les usages individuels.

La question n’est donc plus de savoir s’il faut être « pour ou contre » l’IA, mais bien de définir « comment » l’intégrer de manière éthique, sécurisée et bénéfique pour tous. C’est tout l’enjeu de la stratégie nationale « IA et données de santé 2025-2028 », qui ambitionne de construire une « IA de confiance, au service de tous » en s’appuyant sur un cadre de gouvernance solide et des données françaises et européennes [5].

L’objectif final, partagé par les associations de patients comme par les soignants, n’est pas de remplacer les médecins par des algorithmes, mais bien de permettre l’émergence de « patients augmentés par l’IA » [1], plus autonomes et mieux informés, et de médecins recentrés sur le cœur de leur métier : le soin et l’humain. L’IA sera une alliée précieuse, à la condition que nous ne sacrifions jamais, au nom du progrès technologique, les valeurs de solidarité, de confiance et de protection qui sont le socle de notre système de santé.

Cette bibliographie a été conçue pour offrir au lecteur une transparence totale sur les sources qui ont nourri la rédaction de l’article « GPT Health : l’IA va-t-elle transformer notre santé ? ». Conformément au guide rédactionnel Okimydoc, chaque référence est accompagnée d’un commentaire détaillé explicitant son apport spécifique. L’objectif est de croiser les perspectives — celles des associations de patients, des médias économiques, des juristes spécialisés, des médecins, et des pouvoirs publics — afin de fournir une vision à 360 degrés des enjeux soulevés par l’arrivée de l’intelligence artificielle dans le parcours de soin. La sélection s’est portée sur des publications récentes (2024-2026) pour garantir la pertinence et l’actualité des informations.

Liste des références commentées

[1] France Assos Santé

-

Type de source : Article de position d’une association de patients.

-

Référence complète : France Assos Santé. « Lancement de « ChatGPT Health » : menace sur la consultation médicale ? ». France Assos Santé. 15 janvier 2026.

-

Apport à l’article : Cette source est fondamentale car elle ancre l’article dans la perspective des premiers concernés : les patients. Elle fournit le chiffre clé de 230 millions de requêtes santé hebdomadaires qui sert d’accroche à l’article. De plus, elle expose clairement la position des associations de patients français, partagées entre le besoin d’information et l’inquiétude face aux risques pour la confidentialité et la relation de soin. Elle a permis de formuler la problématique centrale de l’article.

[2] Les Echos

-

Type de source : Article de presse économique spécialisée.

-

Référence complète : Boone, Joséphine. « « L’IA est incroyablement sous-exploitée dans la médecine » : la santé, nouvelle terre de conquête des chatbots ». Les Echos. 22 janvier 2026.

-

Apport à l’article : Cet article offre une analyse économique indispensable pour comprendre les forces en présence. Il fournit les données chiffrées sur la taille du marché de l’IA en santé et ses projections de croissance exponentielle (50 milliards USD en 2025, 1000 milliards en 2035). Il détaille également les stratégies des géants de la tech et l’accueil très favorable des professionnels de santé, ce qui a permis de contextualiser l’ampleur du phénomène.

[3] IREDIC (Institut de Recherche et d’Études en Droit de l’Immatériel et du Numérique)

-

Type de source : Analyse juridique spécialisée.

-

Référence complète : Grillet, Romane. « Chatgpt santé : l’IA médicale face au rempart règlementaire européen ». IREDIC. 21 janvier 2026.

-

Apport à l’article : Source cruciale pour la section sur la comparaison réglementaire France-USA. Cette analyse juridique très précise détaille la divergence des modèles et explique en profondeur les trois principaux obstacles réglementaires européens : le RGPD (données sensibles, consentement), la souveraineté des données (arrêt Schrems II, Cloud Act) et l’AI Act (classification en « haut risque »). C’est la colonne vertébrale de l’analyse sur le « grand écart » réglementaire.

[4] Le Monde

-

Type de source : Article de presse généraliste (vulgarisation scientifique).

-

Référence complète : Gozlan, Marc. « Diagnostic médical : quand l’intelligence artificielle se met à raisonner comme un médecin ». Le Monde. 4 novembre 2025.

-

Apport à l’article : Cet article est essentiel pour la section sur le rôle du médecin. En analysant l’étude comparative du New England Journal of Medicine (Dr Dhaliwal vs Dr CaBot), il illustre de manière concrète et accessible la différence fondamentale entre le raisonnement probabiliste de l’IA et l’intuition critique et causale du clinicien. Il a permis de développer l’idée du « médecin augmenté » et de positionner l’IA comme un outil complémentaire et non un substitut.

[5] Ministère de la Santé et de la Prévention

-

Type de source : Document institutionnel (stratégie gouvernementale).

-

Référence complète : Ministère de la Santé et de la Prévention. « Stratégie intelligence artificielle et données de santé 2025-2028 ». Gouvernement.fr. Novembre 2025.

-

Apport à l’article : Ce document officiel présente la vision et la feuille de route du gouvernement français. Il a été utilisé dans la conclusion pour montrer que la question n’est plus « pour ou contre » mais « comment », et pour présenter la voie française d’une « IA de confiance, au service de tous », offrant une perspective constructive et institutionnelle.

[6] Fierce Healthcare

-

Type de source : Article de presse spécialisée (santé/tech).

-

Référence complète : Fierce Healthcare. « 67% of doctors use AI daily in their practice, survey finds ». Fierce Healthcare. 7 janvier 2026.

-

Apport à l’article : Fournit une statistique très récente et percutante sur le taux d’adoption très élevé de l’IA par les médecins aux États-Unis (67% d’usage quotidien). Ce chiffre est un pilier du tableau comparatif et permet d’objectiver la maturité et la vitesse d’adoption du marché américain.

[7] PulseLife

-

Type de source : Baromètre (enquête d’une entreprise du secteur).

-

Référence complète : PulseLife. « Baromètre IA en santé : alliée ou menace ? ». PulseLife Blog. 31 janvier 2024.

-

Apport à l’article :

Leave a Comment